2025年, 全球企业在AI基础设施上砸下了钱, 保守估计超过3000亿美元.

然后呢?走进任何一家财富500强的数据中心, 你大概率会看到相同宽度标准定妆照: 一排排抢险的GPU服务器, 心跳疯狂, 风扇嘶吼, 机房温度被精密空调控制在完美的22——但当你切入后台时, 会发现上面的实际业务负载, 可能还不如一个大学生的毕业设计项目.

这就是 2026 年科技界最荒诞的奇观: 企业花了买法拉利的钱, 把它停在恒温车库里, 每天烧着昂贵的汽油, 只为了听听引擎的轰鸣声. 采购部满分完成了 KPI, CTO 在董事会上展示了壮观的机柜矩阵, CEO 在财报电话会上骄傲地向华尔街宣布“我们已全面拥抱 AI”. 至于这些天价算力到底算出了什么商业利润?没人追问, 也没人敢追问.

这些设备在圈内有一个精准的绰号——“赛博盆栽”. 它们被精心采购, 小心供养, 定期浇水(交天价电费), 唯一的功能就是向外界证明“我们有”. 这跟老板办公室里那盆从不开花的绿萝, 本质上没有任何区别.

算力 $\neq$ 能力. 采购 $\neq$ 部署. 部署 $\neq$ 产出. 这三句话之间深不见底的鸿沟, 就是整个企业界正在缴纳的最昂贵的“幻觉税”.

一, 看不见的“极客税”与工程深渊

硬件是明码标价的. 一块旗舰级 AI 芯片, 市场报价清清楚楚, CFO 闭着眼签字就完事了. 但真正吞噬预算的怪兽, 永远藏在采购单的背面.

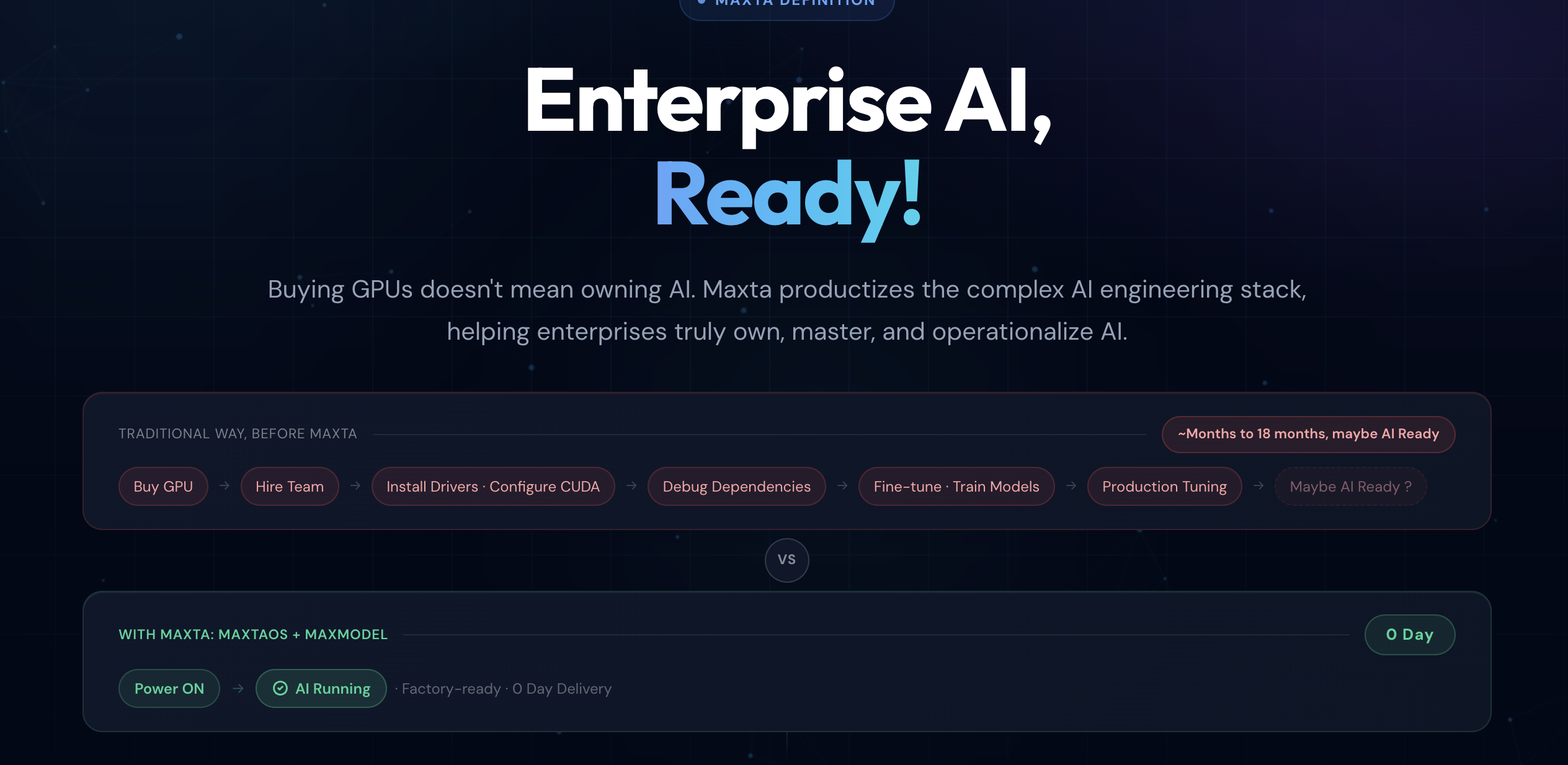

把一个 AI 模型从发布会的 Demo 真正搬到企业的生产环境里, 中间隔着一个绝望的工程深渊. 环境要配置, CUDA 要对齐, 容器要编排, 量化要做, 推理管线要搭, 网络隔离要处理. 这里的每一步, 都是吞噬人力和时间的黑洞.

算一笔残酷的账: 一台顶配边缘推理服务器的硬件成本假设是 20 万美元. 但要让它在车间或业务线稳定吐出哪怕一条有价值的数据, 你需要至少 2 到 3 名年薪 30 万美元起步的基础设施(Infra)工程师, 花 3 到 6 个月去趟坑. 隐性成本, 往往是显性硬件成本的 3 到 5 倍.

这就是残忍的**“极客税”**——你以为买的是即插即用的生产工具, 其实买的是一张通往无底洞的单程票. 绝大多数企业的最终结局出奇的一致: 硬件到位半年后, 项目依然死死卡在 PoC(概念验证)阶段, 最终正式宣告退役, 化作一具具精美的“赛博盆栽”.

二, 硬件溢价掩盖下的“软件懒惰”

现在, 来戳破一个整个行业心照不宣的谎言.

以边缘推理为例. 一台 500 美金的高配终端, 和一台 150 美金的普通 X86 迷你主机, 跑同一个 7B 参数的量化大模型, 性能差距到底有多大?在经过极致的软件层和内核级优化后, 答案会让很多人破防: 差距极小, 甚至可以完全抹平.

那多花的 350 美金买到了什么?更好的芯片封装?当然. 但更诚实的答案是: 你花钱买到了“不用去死磕底层软件优化”的特权.

硬件溢价的本质, 是软件懒惰的遮羞布.

当操作系统的调度机制臃肿不堪, 推理框架未经深度调优, 内存管理一塌糊涂时, 最简单粗暴的解决办法是什么?换一台更贵, 显存更大的机器. 用资金的蛮力去堆砌算力, 用无上限的预算去掩盖底层工程的无能. 这背后暴露出的是一个行业畸形: AI 硬件供应链已经极度成熟, 但 AI 的底层软件栈(OS)依然处于粗制滥造的蛮荒时代. 没有标准, 没有可靠的底层抽象, 每一次部署都像是在做一场定制化开颅手术.

三, 从 IT 玩具到 OT 工具的傲慢与错位

如果说云端的问题是烧钱, 那当 AI 走向工业现场(Edge 端)时, 问题就变成了灾难. 因为 IT(信息技术)世界和 OT(运营技术)世界, 完全是两套宇宙法则.

IT 的逻辑是拥抱不确定性: 出了 Bug?推个 Hotfix 补丁. 服务扛不住了?云端自动扩容. 但在 OT 的逻辑里: 产线停一秒, 损失几万块; 设备误判一次, 可能出人命. 工业现场不需要所谓的“弹性架构”, 它只需要一个词——绝对的确定性.

为什么几十年前发明的 PLC(可编程逻辑控制器)能统治工厂半个世纪?因为它做到了硅谷精英至今做不到的事: 物理隔离, 插电即用, 0Day 交付. 不需要配网络, 不需要敲命令行.

再看看现在的 AI 行业塞给制造业的是什么破烂?一台需要全程联网激活的服务器, 一堆天天报依赖错误的 Docker 容器. 真正的工业级边缘 AI 节点, 必须是一个纯粹的黑盒: 通电, 就绪, 干活. 如果你的设备运到工厂还需要派架构师驻场三周才能跑通, 那你卖的根本不是产品, 而是一个永远无法交付的泥潭.

四, 打破幻觉, 回归商业常识

2026 年, 企业 AI 支出的最大悲剧, 不是钱花少了, 而是钱花错了地方. 企业正在为“部署的过程”买单, 而不是为“业务的结果”买单.

真正的 AI 能力, 绝不以“你有多少张 GPU”来计价, 它只应该以“确定性”为单位来交易: 模型上线第一天能不能稳定服务?断网时能不能本地持续输出?车间工人按下按钮, 它能不能立刻开始推理?

停止为算力付费. 停止为无底洞的调试过程付费. 企业只应该为一件事掏钱: 通电那一刻, 业务就开始产生利润的确定性. 在这场算力狂欢的终局, 赢家绝不会是囤积了最多 GPU 的公司, 而是那个能把极其复杂的 AI 底层工程彻底抹平, 让大模型像水电煤一样“开机即就绪”的破局者.